- 博客

- Sketch to Image AI vs AI 设计工程师:手绘依然制胜

Sketch to Image AI vs AI 设计工程师:手绘依然制胜

目录

- 目录

- Sketch to Image AI 和 AI 设计工程师分别在做什么 {#what-they-do}

- 主流 Sketch to Image AI 工具横评 {#top-tools}

- Sketch To

- Scribble Diffusion(Replicate)

- ControlNet on Stable Diffusion(自部署)

- Adobe Firefly Sketch-to-Image

- Krea AI 实时草图

- Flowstep、v0、Galileo AI、Magic Patterns

- 功能对比表:Sketch to Image AI vs AI 设计工程师 {#feature-comparison}

- 按用户类型和场景该怎么选 {#how-to-choose}

- 为什么手绘草图依然是最佳输入 {#why-sketches-win}

- 实操:用 Sketch to Image AI 把草图变写实照片 {#how-to-turn}

- 真实使用场景 {#use-cases}

- FAQ {#faq}

分享

2026 年 5 月 6 日,Flowstep 登上 Product Hunt 第 3 名,slogan 是"AI design engineer,把你的想法变成可编辑的 UI"。设计师圈第一时间冒出一个问题:手绘本是不是该扔了?

短答:不该扔。完整的答案需要先认清两件事——sketch → UI 代码 和 sketch → 写实图像 是两件完全不同的工作,服务两群完全不同的用户。手绘草图依然是这两条路径里最快、信息最密的输入方式,但只有其中一类工具能把草图变成可印刷可售卖的成品图。本文梳理两者的边界,对比主流 sketch to image AI 工具与新一代 AI 设计工程师,给你一张清晰的选型表。

目录

- Sketch to Image AI 和 AI 设计工程师分别在做什么

- 主流 Sketch to Image AI 工具横评

- 功能对比表:sketch to image AI vs AI 设计工程师

- 按用户类型和场景该怎么选

- 为什么手绘草图依然是最佳输入

- 实操:用 sketch to image AI 把草图变写实照片

- 真实使用场景

- FAQ

Sketch to Image AI 和 AI 设计工程师分别在做什么 {#what-they-do}

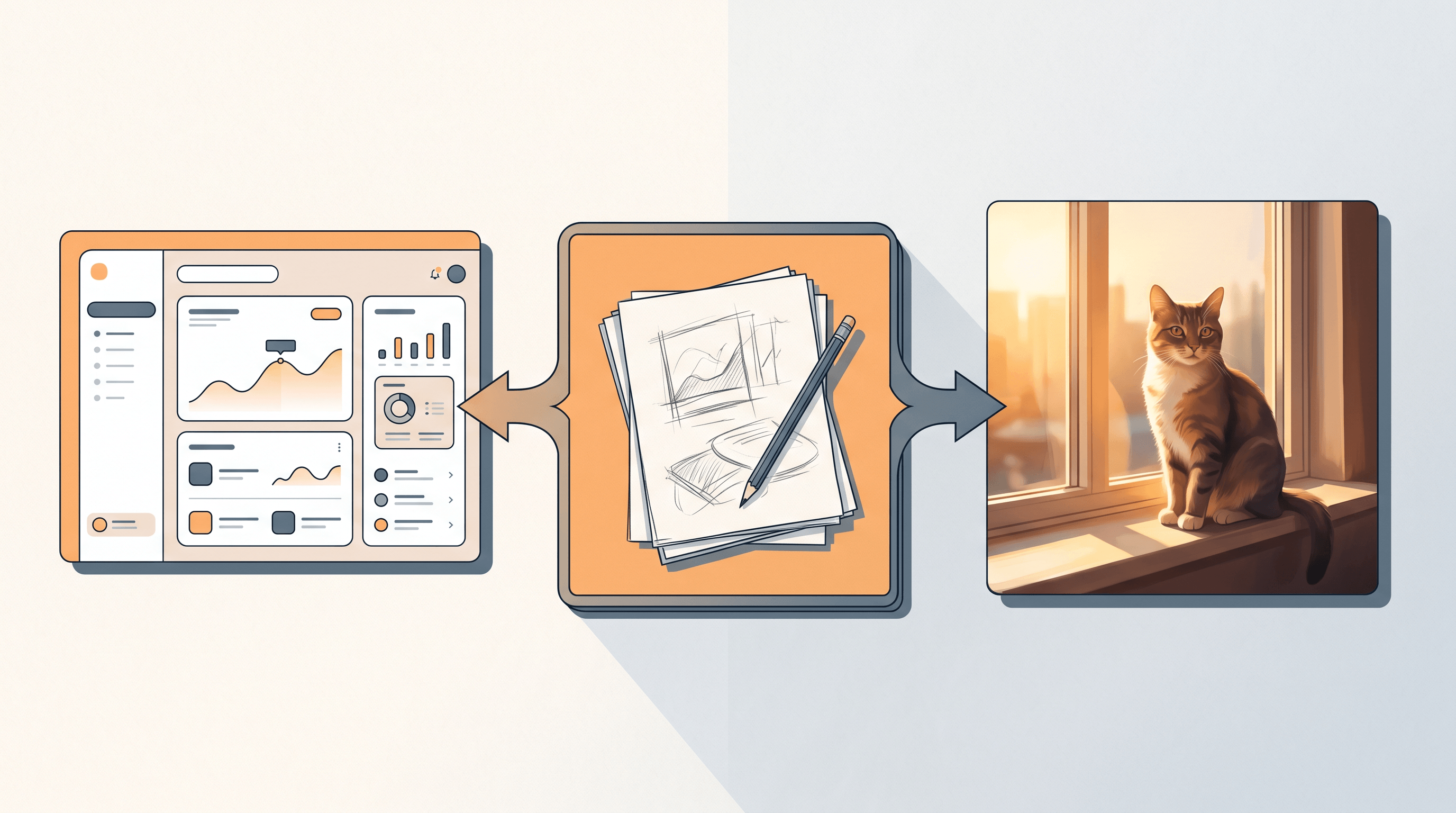

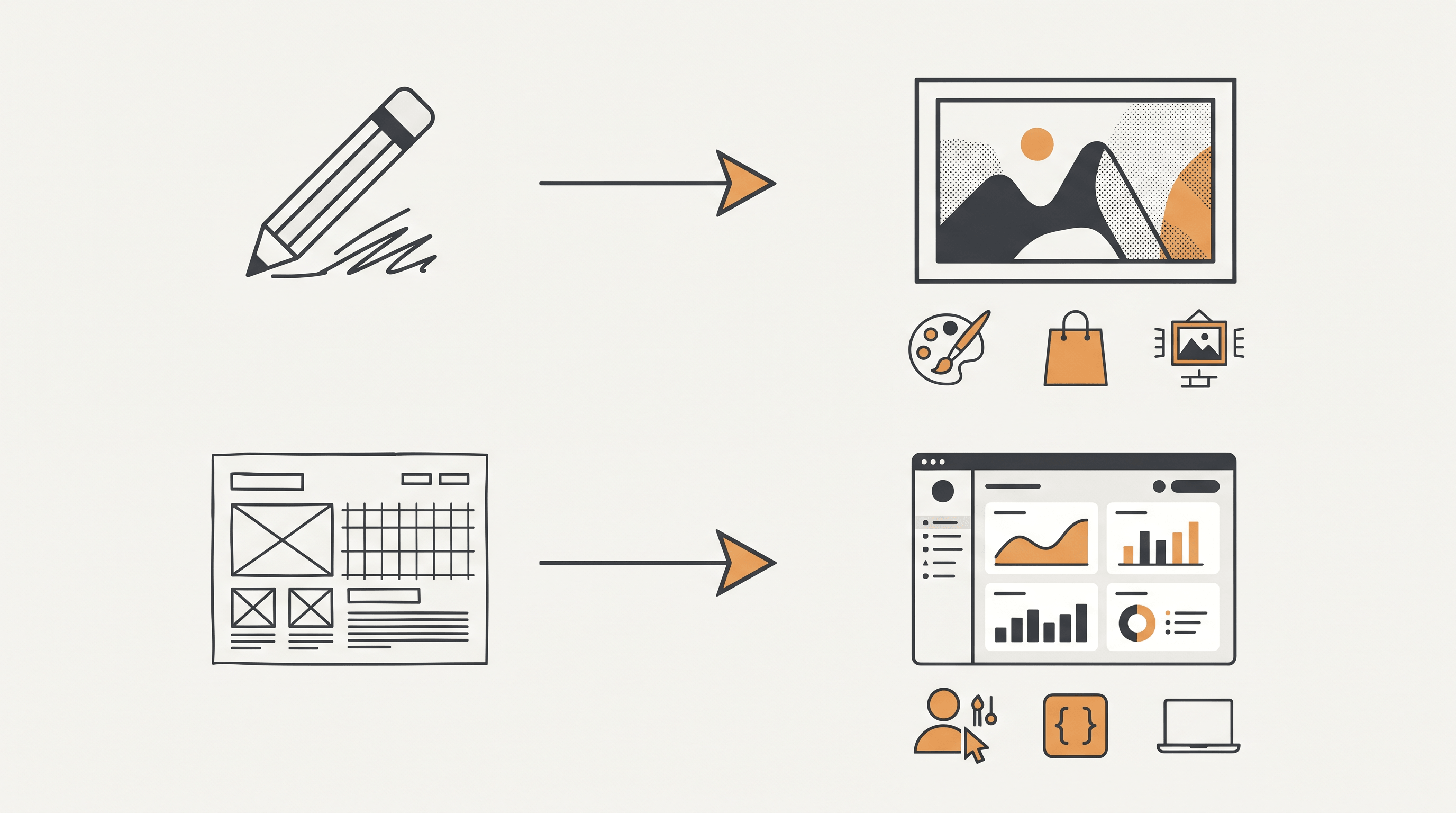

Sketch to image AI 把手绘或扫描的草图变成成品图——写实渲染、精修插画或风格化艺术作品,把你的笔触解读成视觉意图。AI 设计工程师拿到的输入则是文字提示或粗糙线框,输出的是可生产的 UI 代码(React、Tailwind、design tokens)。起点都可以是草图,终点完全是两种东西。

Sketch to image AI 这条线的代表是 Sketch To、Scribble Diffusion、PaintsUndo,以及基于 ControlNet 的 Stable Diffusion 工作流。它的用户是插画师、概念艺术家、电商视觉设计师和爱好者,需要的是一张 JPG 或 PNG 成品。

AI 设计工程师——Flowstep、Vercel v0、Galileo AI、Magic Patterns、Anima——是 2024–2026 年"自然语言是新编程语言"浪潮的产物。它的用户是产品设计师和前端工程师,需要的是可编辑的代码或可部署的组件。

同样一张草图丢给两类工具,意义完全不同。这是判定要选谁的第一道分水岭,搞错就是几小时打水漂。

主流 Sketch to Image AI 工具横评 {#top-tools}

2026 年最强的 sketch to image AI 工具有 Sketch To、Scribble Diffusion、ControlNet on Stable Diffusion、Adobe Firefly Sketch-to-Image 和 Krea AI 实时草图。每个工具在速度、写实度、可控性上各有取舍。我们把同一张猫咪线稿丢进每一个工具,差异如下。

Sketch To

- 适合:从粗稿或精稿出写实渲染;电商产品 mockup;插画精修。

- 不适合:生成 UI 界面或可分图层文件。

- 要点:Standard 模型适合快速迭代,Professional 模型出客户级精度。新用户有免费试用积分,付费档从 $8/月起。

Scribble Diffusion(Replicate)

- 适合:免费快速试错;看同一张草图在不同风格下的表现。

- 不适合:需要多帧风格一致的商业项目。

- 要点:开源 ControlNet 模型托管在浏览器即开即用,无需注册。

ControlNet on Stable Diffusion(自部署)

- 适合:高玩用户,需要 scribble、depth、pose 多重条件控制。

- 不适合:新手——需要本地 GPU 或付费托管,外加 prompt 调优。

- 要点:自部署灵活度最高,学习曲线也最陡。

Adobe Firefly Sketch-to-Image

- 适合:已经在 Creative Cloud 体系内的设计师,需要商用安全。

- 不适合:极致写实——精度不及垂直工具。

- 要点:训练数据来自授权的 Adobe Stock,商用合规。

Krea AI 实时草图

- 适合:实时构思——拖动形状立即看到渲染更新。

- 不适合:高清成品——分辨率较低。

- 要点:订阅制,延迟低于 200 ms 是核心卖点。

对比之下,AI 设计工程师这边长这样:

Flowstep、v0、Galileo AI、Magic Patterns

- 适合:从一句话或粗略线框跑到 React/Tailwind 代码。

- 不适合:任何需要交付 JPG / PNG 的工作(插画、海报、产品照、角色艺术)。

- 要点:Flowstep 2026 年 5 月发布日 264 票冲到 PH #3,说明这条路径有真实需求。

功能对比表:Sketch to Image AI vs AI 设计工程师 {#feature-comparison}

最直观的方式:把 sketch to image AI 和 AI 设计工程师按输入、输出、目标用户、最佳/最差使用场景排开。它们在"灵感"层重叠,在"交付物"层完全分叉。

| 维度 | Sketch to Image AI(如 Sketch To) | AI 设计工程师(如 Flowstep) |

|---|---|---|

| 主要输入 | 手绘或扫描草图 | 文字提示或粗略线框 |

| 输出格式 | JPG / PNG 图片 | React / Tailwind 代码、可编辑 UI |

| 目标用户 | 插画师、概念艺术家、电商视觉 | 产品设计师、前端工程师 |

| 最佳场景 | 角色插画、产品渲染、海报、包装 | 落地页、Dashboard、SaaS UI |

| 最差场景 | 做可点击的界面 | 出英雄区插画 |

| 单次出图时间 | 8–30 秒(Standard)/ 30–60 秒(Pro) | 30 秒–2 分钟(整页 UI) |

| 可编辑性 | 重新生成、改 prompt、丢进图像编辑器 | 直接改代码或可视化微调 |

| 价格区间 | $0–$16/月 | $0–$30/月 |

| 商用授权 | 多数付费档可商用,按工具看 | 代码归你,生成素材按工具看 |

最关键的一行是"输出格式"。终点是像素就用 sketch to image AI,终点是 DOM 就用 AI 设计工程师。混淆这一点要花的代价不是几分钟,是几小时。

按用户类型和场景该怎么选 {#how-to-choose}

按交付物选,不要按潮流选。需要"图"——海报、Etsy 商品图、作品集——选 sketch to image AI;需要"可上线的界面"——选 AI 设计工程师。两者很少能互相替代。

插画师 / 概念艺术家:sketch to image AI 是主力。当你已经知道想要的姿势和构图,手绘比敲 prompt 快 3–5 倍。Sketch To 的 Professional 模型客户级写实度足够交稿。(风格化的工作流可参考我们的 reasoning-first AI imaging workflow 拆解。)

电商和产品团队:sketch to image AI 出商品 mockup 和场景图,AI 设计工程师出店面 UI 本身。成长期品牌通常两条线并跑——一条做素材,一条做界面。

产品设计师 / 前端工程师:Flowstep 这类 AI 设计工程师在常见模式的初稿上已经真正可用了。但空状态、营销 hero 插画、品牌视觉这些还是要靠 sketch to image AI——UI 生成器做不出这些。

学生和爱好者:从 Scribble Diffusion 的免费层或 Sketch To 的免费试用积分起步。比 ControlNet 自部署的曲线友好得多。

为什么手绘草图依然是最佳输入 {#why-sketches-win}

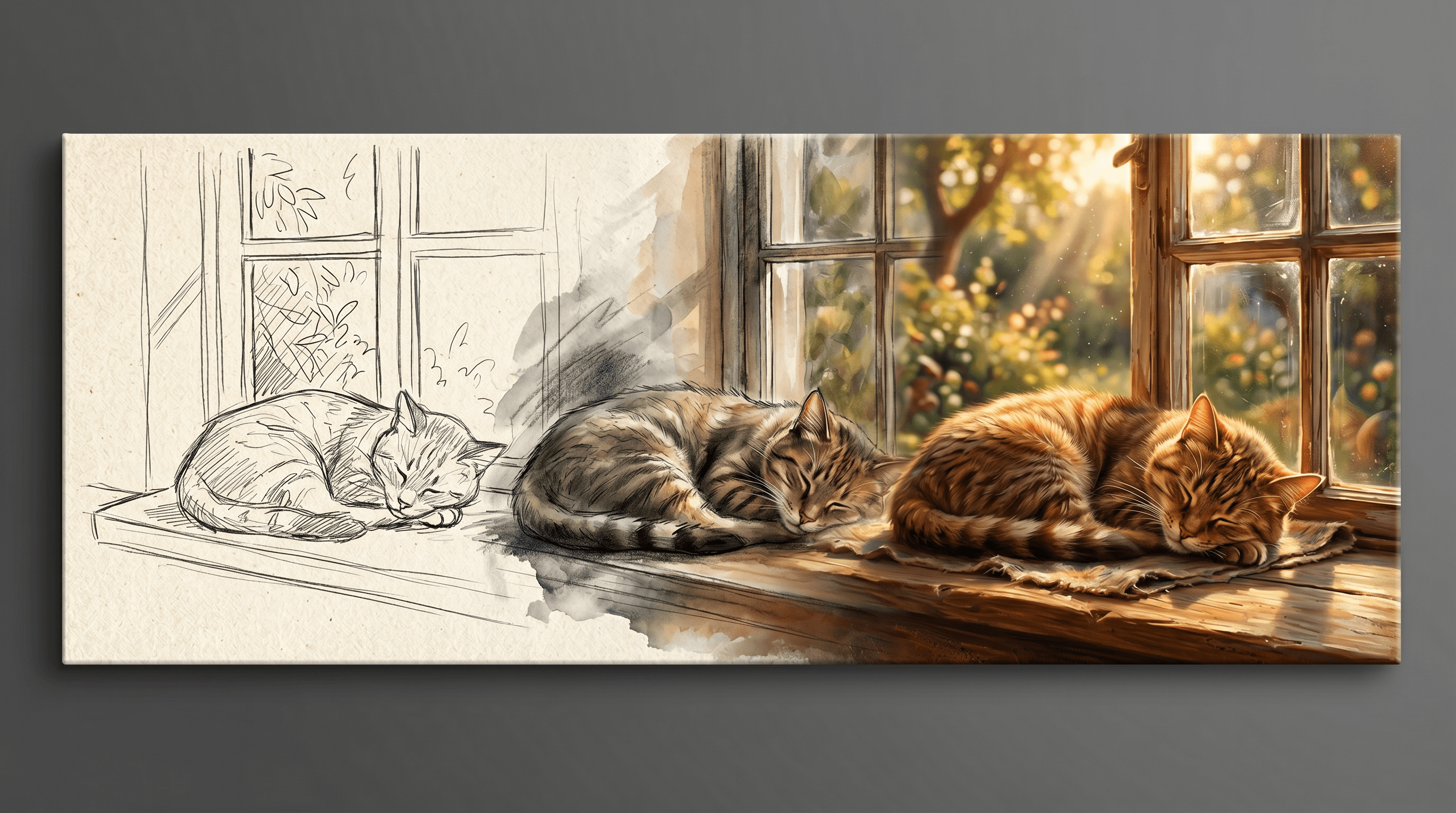

草图编码的信息,文字 prompt 表达不出。30 秒的铅笔草图同时承载姿势、构图、光线方向和动势——"一只猫坐在窗台上的金色时光"做不到。这种信息密度是 sketch to image AI 能成为独立品类、而不是埋在通用文生图工具里一个开关的原因。

手绘依然不可替代的三个理由,即使 AI 设计工程师再变强也不会改变:

-

草图传达 prose 表达不了的空间意图。 试着用文字描述一只手的精确角度,或一点透视的退缩感。一段话写下来,模型还在猜。一笔草图两秒钟搞定。

-

肌肉记忆比键盘 prompt 快。 画了多年画的设计师/插画师在纸上或数位板上的迭代速度,是 prompt 栏的 3–5 倍。擦掉一根线远比改写一句话快。

-

草图保留创作主权。 用自己的草图做出来的 AI 成品,构图是你的、笔触逻辑是你的、想法是你的。纯文字 prompt 把太多东西外包给了模型。给客户交稿的工作室在乎这一点——出处和意图都要立得住。

这些理由不会因为 AI 设计工程师变强而消失。把草图丢给 Flowstep 或 v0,它会当成线框读,吐出代码。同一张草图丢给 sketch to image AI,回来的是一张能打印能发能卖的图。

实操:用 Sketch to Image AI 把草图变写实照片 {#how-to-turn}

最快的路径是一个 4 步循环,1 分钟内能跑完。我们用同一张草图——窗台上的猫——分别跑了 Sketch To 的 Standard 和 Professional 模型做对比。

-

扫描或拍下你的草图。 手机相机就够,注意均匀打光、对比清晰。白底有助于模型识别笔触。

-

上传草图到 Sketch To,选模型。 Standard 大约 8–10 秒出图,适合做构思;Professional 模型大约 20–30 秒,毛发、布料、光线纹理明显更扎实,更接近 hero 级成品——这是 sketch to image AI 真正发力的地方。

-

加一句风格提示。 "photorealistic, soft golden hour lighting, shallow depth of field" 这种就够。sketch to image AI 用草图定布局,用 prompt 调表面质感。

-

针对没出来的部分迭代。 改 prompt、换模型、或调草图重跑。多数人 2–3 次内就能落到可用稿。

我们的实测体感:Professional 模型的毛发细节和光线一致性更适合作品集和商业用途;Standard 模型在前期方案探索阶段更快。

真实使用场景 {#use-cases}

哪里有人脑里已有画面、需要被快速渲染出来,sketch to image AI 就出现在哪里。三种模式占了大头:角色概念稿、产品 mockup、童画转艺术作品。

-

角色概念稿 → 写实人像:游戏工作室和独立动画师先画姿势草图,再用 sketch to image AI 测试材质和光线,再决定是否进 3D。把概念美术周期从几天压到几小时。

-

产品手绘 → 渲染图:工业设计师和 Etsy 卖家先画产品想法(首饰、陶瓷、包装),再生成渲染图用于情绪板,或在样品打样期间作为占位图。

-

儿童画 → 卡通海报:家长扫描孩子的画,转成精修卡通或电影海报风格的打印件。生日礼物、教室展示、Etsy 定制订单都是增长很快的细分。

每一种场景,草图负责承载想法,sketch to image AI 负责完成质感。AI 设计工程师在这里没有竞争空间——根本没有 UI 要交付。

FAQ {#faq}

设计师和插画师第一次接触 sketch to image AI 时最常问的问题,匹配真实搜索里的自然语言表达。

Sketch to image AI 和 DALL-E、纯文生图模型有什么不同? Sketch to image AI 把草图当作空间约束,构图、姿势、比例都跟随你的输入。DALL-E 这类纯文生图模型从零生成构图,更适合"随便给我一张"的场景,但你心里有具体布局时它不可靠。

我画工很差,能用 sketch to image AI 吗? 能。包括 Sketch To 在内的多数 sketch to image AI 工具都对粗略笔触和火柴人友好。你提供布局和意图,模型负责渲染。很多用户从粗糙线稿起步,照样能拿到干净的结果。

Sketch to image AI 的输出能商用吗? 多数付费档授予商用权利。Sketch To 的 Professional 模型就是为商业用途设计的;Adobe Firefly 训练数据是授权素材。售卖前请确认具体工具的条款,尤其是当草图涉及真人或商标时。

Sketch to image vs sketch to UI——我该用哪个? 要的是成品插画、写实照片或艺术作品,用 sketch to image AI;要的是可上线的界面、Dashboard 或网页,用 Flowstep、v0 这类 AI 设计工程师。两者不可互换,即便都能读草图。

Sketch to image AI 出图要多久? 多数工具 8–30 秒出标准稿,20–60 秒出高细节稿。Krea 这类实时工具响应在 200 ms 以内,但分辨率较低。Sketch To 的 Professional 模型属于高细节档,准备发布的图我们都建议走这一档。

AI 设计工程师以后会取代 sketch to image AI 吗? 不会。两者优化的交付物不同。AI 设计工程师会越来越擅长代码和 UI;sketch to image AI 会越来越擅长图像。一个产品团队两边都要——一个上线界面,一个产出周边视觉。

Last updated: 2026-05-06.

有一张想活过来的草图吗?免费试用 Sketch To → — 进入 Professional 模型,作品集级别的写实度,无需任何设计学位。

分享

Sketch To

专注 AI 工具、图像处理和创意工作流的技术写作者。

相关文章

Magnific 替代品 2026:7 款 AI 图片放大工具横评

Freepik 本周改名 Magnific。横评 7 款 AI 放大工具:Magnific、Topaz、Krea、Upscayl、Let's Enhance、Clipdrop、Sketch To。

2026 年最佳 AI 图片生成器替代品对比:5 款实测

Krea AI、Freepik AI、Openart AI、Higgsfield、Sketch To 横评对比,功能、价格、实测结果,帮你选出最适合的 AI 图片生成器替代品。

ChatGPT Images 2.0 替代方案:草图转照片选什么

ChatGPT Images 2.0 主打会思考的图像生成,但草图转真实照片场景下,垂直工具 Sketch To 仍有差异化优势。看完整对比和决策指南。